Você está conversando com um bot de GPT?

Este artigo tem como objetivo ensinar vários truques e técnicas populares para detectar quando você está conversando com um bot de mídia social, de site de namoro ou de help desk, especialmente quando não há aviso e o bot está tentando se passar por um humano. Estou me referindo especificamente a chatbots como o ChatGPT, não a qualquer bot.

A inteligência artificial resolve muitos de nossos problemas e, muitas vezes, nos permite realizar tarefas de forma mais rápida, mais produtiva e melhor do que antes.Entretanto, a IA também representa uma séria ameaça de várias maneiras, e não estou falando apenas de empregos. Ela comete muitos erros, muitas vezes fornece informações falsas, desperdiça nosso tempo, prejudica nosso bom senso e limita nossa capacidade de pesquisar e tirar nossas próprias conclusões.

A IA também ameaça a privacidade e a segurança, tanto individual quanto coletivamente, porque pode ser usada para criar notícias, fotos e vídeos falsos como nunca antes. Por fim, e este é o tópico principal deste artigo, a IA pode simular perfeitamente pessoas reais, fazendo-se passar por elas em chats, sites de relacionamento e serviços de suporte e muito mais. Isso é comum nas mídias sociais (seguidores falsos, curtidas etc.), mas também em chats e sites de namoro. Portanto, queremos alertá-lo sobre esse perigo e fornecer ferramentas eficazes para ajudá-lo a detectar quando você está conversando com uma IA ou com uma pessoa real.

Não temos a pretensão de oferecer uma solução perfeita e que funcione sempre, mas tenho certeza de que, depois de ler este artigo, você saberá muito melhor se está sendo enganado ou tratado com honestidade.

Como os chatbots funcionam?

Apesar da imagem no início deste artigo - um robô futurista segurando um telefone celular - os chatbots não são tão impressionantes na realidade. Eles são simplesmente programas de computador, geralmente escritos em Python ou em outras linguagens, que geram mensagens e conversas de uma forma tipicamente humana. Eles fazem isso analisando estatisticamente bilhões de textos e conversas. Além disso, usando modelos matemáticos complexos, eles imitam o funcionamento dos neurônios humanos para gerar pensamentos e ideias.

Entretanto, eles não são cópias perfeitas de nós. Apesar da imitação, eles continuam sendo programas de computador, geralmente treinados para responder a tópicos específicos. É claro que os chatbots nem sempre precisam do poder de geração do ChatGPT, que é um modelo mais geral e, portanto, exige muito mais poder de processamento e dados. Também existem chatbots menores e, embora qualquer programa GPT possa ser detectado por seus padrões de resposta, os chatbots mais simples são ainda mais fáceis de detectar porque são treinados exclusivamente para um assunto específico. Por exemplo, os produtos e serviços oferecidos por um influenciador ou especialista em marketing poderiam ser facilmente apresentados por uma IA treinada em um computador pessoal devido ao contexto limitado de sua área de especialização.

Aqui estão alguns sinais típicos que revelam que você está falando com uma IA que finge ser humana:

- Escopo de conversação limitado: Tente direcionar a conversa para um tópico mais complexo ou diferente. Uma IA indicará rapidamente que não está entendendo ou, se for uma IA mais avançada, não responderá sem nenhum motivo óbvio.

- Não responde a tons provocativos: Se você tentar um tom mais provocativo ou direto, a IA provavelmente se limitará a uma resposta educada e politicamente correta. Embora um representante de atendimento ao cliente treinado também possa fazer isso, ele geralmente tentará mudar de assunto ou transferir você. Uma IA permanecerá em seu caminho pré-programado.

- Ofertas de serviços inflexíveis: Se estiver oferecendo um serviço, tente fazer uma contraoferta. Por exemplo, se ele estiver propondo o gerenciamento de mídia social, pergunte sobre parcerias comerciais. Se ele continuar oferecendo os mesmos serviços e parecer incapaz de se desviar, é provável que se trate de uma IA.

- Desvio de tópico: Em um bate-papo geral, se a IA mudar a conversa para um tópico diferente sem mostrar que entendeu seu ponto anterior, ela provavelmente está presa em seus parâmetros de treinamento.

Aqui estão alguns sinais típicos que revelam que você está falando com uma IA que finge ser humana:

- Respostas instantâneas e longas: Ele responde instantaneamente com grandes quantidades de texto, como se estivesse colando respostas ou digitando mais rápido do que 106 palavras por minuto (a velocidade média da fala humana é de 106-109 ppm).

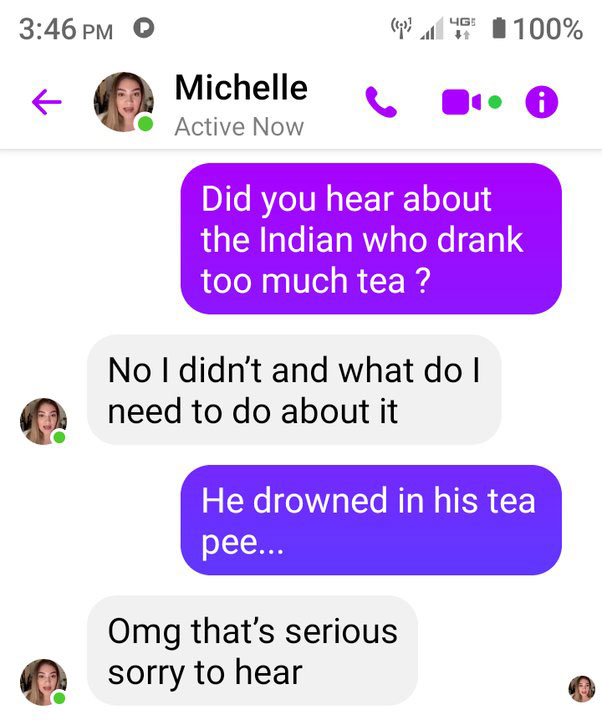

- Interpretação literal: Ele leva tudo ao pé da letra, muitas vezes em um grau exagerado, quase grotesco (embora isso possa ser uma característica de alguns indivíduos autistas).

- Respostas vagas e genéricas: Ele fornece respostas vagamente relacionadas à sua pergunta, às vezes repetindo suas palavras para simular atenção - um truque antigo.

- Disponibilidade inabalável: Ele está sempre disponível, não importa a hora em que você o contate, e fornece consistentemente as mesmas respostas a perguntas repetidas com variação mínima.

- Consulta de data: Esse truque é muito conhecido e discutido nas mídias sociais. Pergunte a data de hoje. Uma resposta excessivamente formal como Hoje é quinta-feira, 26 de outubro de 2023, sem nenhuma surpresa ou hesitação, é um forte indicador. Um ser humano provavelmente responderia de forma menos rígida, mesmo que estivesse tentando ser útil.

Por fim, aqui estão alguns sinais mais gerais:

- Tempo de resposta consistente: Modelos mais avançados podem usar um atraso consistente entre o recebimento de uma mensagem e a resposta. Um atraso variável ou aleatório é menos comum.

- Complexidade de resposta uniforme: As respostas da IA tendem a manter um nível consistente de complexidade e estrutura, enquanto as respostas humanas variam em estilo, ritmo e complexidade.

- Erros e repetição: Embora as respostas da IA possam estar livres de erros, elas ainda podem apresentar erros sintáticos ou semânticos. A ortografia perfeita também pode ser um sinal de artificialidade.

- Falta de nuance cultural/emocional: A IA geralmente não percebe sutilezas culturais, emocionais ou contextuais.

- Ser muito direto: Fazer perguntas diretas sobre opiniões pessoais ou experiências muito específicas pode revelar com quem você está interagindo. Se você disser algo absurdo e receber uma resposta como se fosse perfeitamente normal, é provável que esteja falando com uma IA.

É claro que interagir com uma IA nem sempre é ruim. Às vezes, uma resposta de uma IA especificamente treinada para resolver um problema em um determinado contexto é muito melhor e mais rápida do que esperar por um agente humano. Mas tudo depende do contexto e, em geral, você, como usuário, deve estar sempre informado e nunca permitir que alguém o engane fingindo ser alguém que não é.

Mais IA ou menos IA?

O que discutimos até agora traz uma pergunta óbvia: Em última análise, a IA é positiva ou negativa? Bem, é inevitável que o progresso humano acabe chegando a esse ponto. Ao longo da história, sempre que uma nova tecnologia surgiu, alguns empregos foram perdidos e novos foram criados. Esperamos que isso também aconteça com a IA. Sem acreditar nos mitos do estilo Terminator sobre a IA nos escravizar, devemos aceitar o progresso como ele é, pois não podemos lutar contra a realidade.

No entanto, é fundamental promulgar leis e regulamentações rigorosas para evitar os inevitáveis abusos da IA. Por exemplo, precisamos de leis que exijam que os usuários sejam informados se estiverem interagindo com uma máquina, que proíbam a criação de notícias falsas e que exijam a rotulagem clara do conteúdo gerado por IA.

Acima de tudo, os geradores de modelos de linguagem, como o ChatGPT, devem ser obrigados a incorporar padrões que permitam que humanos e outras máquinas identifiquem inequivocamente o conteúdo gerado por humanos e o gerado por IA. Essas leis ajudariam a limitar os abusos e a destacar as vantagens que a IA oferece. Só então essa inovação recente e altamente controversa poderá ser considerada realmente benéfica para o progresso e a produtividade.